Introducción

El viejo sueño de conversar con otras especies, popularizado por el Dr. Dolittle, ha dejado de ser una fantasía literaria. El avance vertiginoso de la Inteligencia Artificial (IA) y, en particular, del aprendizaje automático (machine learning), abre hoy la posibilidad de analizar vocalizaciones, posturas corporales y micro-expresiones de un número creciente de animales con una resolución y una velocidad inimaginables hace apenas una década (1, 2). Para el veterinario clínico y, especialmente para el especialista en comportamiento, este salto tecnológico promete ofrecer herramientas objetivas para evaluar el dolor, el estrés y el bienestar, optimizar la medicina preventiva e, incluso, apoyar la conservación de fauna salvaje. Sin embargo, junto a la fascinación tecnológica, emergen retos metodológicos y dilemas éticos ineludibles.

Este artículo repasa los fundamentos técnicos de la IA aplicada a la comunicación animal, describe los proyectos pioneros más relevantes, analiza su impacto veterinario inmediato en perros y gatos, proyecta tendencias a dos o cuatro años vista y, sobre todo, plantea una agenda de responsabilidad profesional para que esta revolución digital se traduzca en un auténtico avance del bienestar animal.

¿Cómo “aprende” la IA los idiomas animales?

Las redes neuronales modernas funcionan como voraces detectores de patrones. Expuestas a millones de ejemplos de audio, vídeo o datos multimodales, descubren regularidades acústicas o cinemáticas que, a menudo, superan la perceptibilidad humana (1). Existen dos tipos de aprendizaje:

- Aprendizaje supervisado: el paradigma clásico. Exige ingentes bases de datos etiquetadas por etólogos y clínicos (por ejemplo, catalogar un maullido como “petición de comida»). Su principal cuello de botella es el elevado precio de que los especialistas clasifiquen los datos (3).

- Aprendizaje auto-supervisado y modelos fundacionales: se consideran tecnológicamente disruptivos, es decir, representan una innovación radical que transforma la forma en que abordamos el aprendizaje automático al reducir significativamente la necesidad de grandes cantidades de datos etiquetados. Sistemas como wav2vec 2.0 (1) o NatureLM-audio (4) se entrenan con audio no etiquetado, aprenden la “gramática sonora” general y luego se ajustan con menos datos etiquetados para tareas concretas. Esta estrategia reduce la dependencia de la intervención humana, permite generalizar a especies no estudiadas previamente y posibilita el despliegue en edge devices de bajo consumo, es decir, aparatos que procesan los datos cerca de donde se generan, en lugar de enviarlos a un servidor central o a la nube para analizarlos. En el contexto de comunicación animal, ejemplos de edge devices serían: boyas flotantes que graban y procesan vocalizaciones de cetáceos directamente en el océano; collares inteligentes que analizan en tiempo real los sonidos o movimientos de un animal; o cámaras de vigilancia que detectan comportamientos anómalos en fauna silvestre.

Sin embargo, la riqueza de contexto —quién emite el sonido, en qué situación comportamental, con qué consecuencias—, sigue siendo la variable crítica para lograr interpretaciones semánticas, y no meras correlaciones estadísticas (5, 6).

Gigantes del océano: IA al servicio de cetáceos

Actualmente existen dos proyectos pioneros llevados a cabo en orcas y delfines. El equipo de Bioacústica Física de la Universidad de La Laguna ha entrenado una red neuronal capaz de clasificar en tiempo real los repertorios vocales de Orcinus orca usando hardware del tamaño de una tarjeta de crédito (7). Este avance, presentado en el V Simposium Internacional de Orcas, pretende:

- evaluar bienestar en cautividad,

- filtrar miles de horas de grabaciones históricas y

- entender las controvertidas interacciones con veleros en el Estrecho de Gibraltar.

Por otro lado, el Wild Dolphin Project y Georgia Tech han lanzado un modelo fundacional de 400 millones de parámetros optimizado para ejecutarse en un teléfono Pixel (8). Entrenado con décadas de grabaciones de audio e imagen enlazadas a identidades individuales de delfines moteados, puede predecir secuencias acústicas y, a largo plazo, formar un “vocabulario compartido» limitado, basado en silbidos sintéticos asociados a objetos.

Estos proyectos ilustran un giro clave: llevar la IA del laboratorio al océano para monitorizar en directo a cetáceos y mitigar así ciertas amenazas como las colisiones con barcos, el ruido o la pesca.

Perros y gatos: impacto clínico inmediato

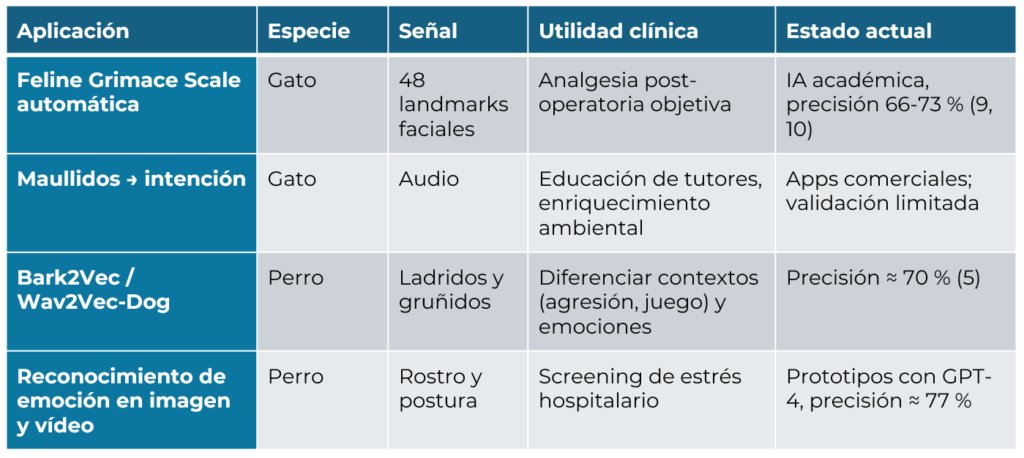

En la siguiente tabla (Tabla 1) se resumen algunas aplicaciones emergentes de la IA en el ámbito de la comunicación y el comportamiento animal, con un enfoque en su utilidad clínica en perros y gatos.

Tabla 1. Aplicaciones de la IA para el análisis de la comunicación y el comportamiento en perros y gatos.

Para el veterinario clínico la lección es clara: las mismas técnicas pueden adaptarse a mamíferos terrestres, pacientes críticos o fauna silvestre bajo rehabilitación.

No obstante, a la hora de aplicar estas técnicas, es importante tener en cuenta algunas consideraciones clínicas, tales como:

- La variabilidad racial (braquicéfalos vs. dolicocéfalos) exige bases de datos estratificadas para evitar “sesgos de cara chata” que comprometan la detección de dolor en Persas o Bulldogs (9).

- Ningún algoritmo sustituye la evaluación clínica integral; su valor radica en objetivar, automatizar y documentar signos sutiles que, de otro modo, pasarían inadvertidos en consultas saturadas.

- El veterinario debe asesorar a tutores sobre las limitaciones de apps de “traducción” comerciales, diferenciando marketing de evidencia revisada por pares.

Más allá de animales de compañía y ballenas: un zoo digital emergente

Modelos como BirdNET (11) o Perch (6) ya identifican cientos de especies de aves y mamíferos por su canto o «ultrasonidos” con precisión de ornitólogo experto. La IA también analiza:

- Rumores infrasonoros de elefantes para anticipar movimientos y evitar conflictos con comunidades rurales (12).

- Danzas de abejas (IA de visión artificial), claves para optimizar polinización en cultivos.

- Patrones de batimetría energética de peces en acuicultura, incluyendo la determinación de sexo en esturiones a partir de ecografías automáticas, con impacto directo en el bienestar y la sostenibilidad productiva.

La tendencia es clara: de herramientas ad hoc para una especie a modelos fundacionales flexibles que convergen en un ecosistema de monitorización de biodiversidad planetaria.

Retos técnicos y éticos

Para abordar de manera responsable el desarrollo y la aplicación de la inteligencia artificial en el estudio del comportamiento animal, es crucial considerar una serie de retos técnicos y éticos:

- Datos y gobernanza. La IA está hambrienta de datos: grabar, etiquetar y compartir implica costes, problemas de propiedad intelectual y riesgos de biopiratería. Los Protocolos FAIR (Findable, Accessible, Interoperable, Reusable) deben armonizarse con salvaguardas que impidan usos maliciosos, como la caza furtiva asistida por IA (13).

- Antropomorfismo. Correlación no es equivalente a comprensión. Si un algoritmo asocia un silbido a «alegría”, estará proyectando un constructo humano. Para interpretar correctamente el significado, es imprescindible validar los resultados mediante observaciones del comportamiento, datos fisiológicos y principios de etología comparada.

- Generalización. Un modelo entrenado en orcas del Atlántico Norte puede fallar con orcas antárticas; la robustez inter-población es todavía endeble (3).

- Autonomía animal y manipulación. Conocer un “grito de júbilo” de orcas no legitima su uso para atraerlas con fines turísticos. Los veterinarios especialistas en medicina del comportamiento proponen aplicar el principio de precaución y priorizar el vínculo frente al control (14).

- Legislación emergente. Si se demuestra que los elefantes son capaces de nombrar individuos (12), ¿cambiaría su estatus jurídico? Los hallazgos en cognición animal impulsados por IA podrían impulsar reformas hacia el reconocimiento legal de los animales como “personas no humanas».

El futuro

El futuro próximo (2025-2029) promete emocionantes avances en la aplicación de la inteligencia artificial en la clínica veterinaria y la conservación animal.

- Clínica diaria: las cámaras de consulta y collares inteligentes ofrecerán paneles (dashboards) en tiempo real de dolor, movilidad y emoción, enlazados a los historiales electrónicos de los pacientes.

- Conservación: las boyas acústicas con IA “edge” emitirán alertas inmediatas a barcos cuando detecten cachalotes o orcas en ruta, reduciendo así las colisiones mortales.

- Modelos multimodales: la fusión de audio, visión y acelerometría permitirá crear gemelos digitales, es decir, representaciones virtuales detalladas y dinámicas de un animal individual o de una población. Estos modelos integran datos de diversas fuentes sensoriales para simular el comportamiento, la fisiología e incluso las interacciones sociales de los animales en tiempo real, tanto de la fauna hospitalizada como de poblaciones salvajes.

- Vocabularios compartidos básicos: especies como delfines, cuervos o cerdos podrían aprender a usar silbidos o iconos para solicitar objetos, de manera similar a sistemas de comunicación asistida (CHAT). Estas aplicaciones serán especialmente útiles en entornos de investigación y programas de enriquecimiento ambiental.

Lo que no veremos todavía es una “traducción simultánea” de pensamientos complejos; la IA aportará una comprensión incremental, no diálogos estilo humano.

Conclusiones

La aplicación de la IA a la comunicación animal ya está transformando la práctica veterinaria: aporta métricas objetivas, reduce el sesgo del observador y amplía la escala de monitorización del bienestar, desde el paciente individual hasta poblaciones enteras. No obstante, el entusiasmo tecnológico debe ir acompañado de rigor científico y un compromiso ético férreo. Desde el GEMCA invitamos a los veterinarios clínicos a:

- Formarse en fundamentos de IA para ser usuarios críticos y garantes del bienestar animal.

- Colaborar con etólogos, ingenieros y conservacionistas para generar bases de datos de calidad con contexto clínico.

- Evaluar con evidencia cualquier herramienta comercial antes de recomendarla a tutores.

- Difundir una cultura de respeto, evitando la tentación de usar el conocimiento obtenido para manipular o explotar.

Quizá el valor más profundo de esta revolución no sea “hablar” con los animales, sino en aprender a escucharles mejor y actuar en consecuencia.

Germán Quintana

Bibliografía

- Baevski A, Zhou Y, Mohamed A, Auli M: wav2vec 2.0: A Framework for Self-Supervised Learning of Speech Representations. Adv Neural Inf Process Syst 2020; 33:12449-12460.

- Sarkar E, Magimai-Doss M: Comparing self-supervised learning models pre-trained on human speech and animal vocalizations for bioacoustics processing. arXiv 2025; 2501.05987.

- Stowell D: Computational bioacoustics with deep learning: a review and future directions. Peer J 2022; 10:e13152.

- Earth Species Project: Introducing NatureLM-audio: An audio-language foundation model for bioacoustics. Earth Species Project Technical Report 2024.

- Abzaliev A, Perez-Espinosa H, Mihalcea R: Towards Dog Bark Decoding: Leveraging Human Speech Processing for Automated Bark Classification. Proc LREC-COLING 2024; 16480-16486.

- Ghani B, Bergler C, Kahl S, et al: Perch: A bioacoustic foundation model for detection and classification of animal vocalizations. arXiv 2023; 2306.11676.

- Rosa F, Lüke J, Caballero N, et al: Real-time classification of killer whale vocalisations using low-power edge hardware. In Proceedings of the V International Orca Symposium, Tarifa, 2025; 42-46.

- Herzing DL, Ghose D, van Agtmael E, et al: DolphinGemma: An open foundation model for dolphin communication. Google AI Blog 2025.

- Feighelstein M, Arnberg T, Zamansky A, Finka LR: Automated recognition of cats’ valence states using facial landmarks. Sci Rep 2023; 13:19031.

- Mazzotti S, Sarkar E, Magimai-Doss M, Zamansky A: Automated video-based pain recognition in cats using facial landmarks. Sci Rep 2024; 14:27589.

- Kahl S, Wood CM, Eibl M, Klinck H: BirdNET: A deep learning solution for passive acoustic monitoring of birds. Ecol Inform 2021; 61:101236.

- Pardo MA, Belknap F, Rivas M, et al: African elephants address individuals with name-like calls. Nat Ecol Evol 2024; 8:1053-1064.

- More Than Human Rights Project: Listening to the more-than-human world: Legal & ethical principles for nonhuman animal communication technologies. OpenGlobalRights 2024; 1-18.

- Bossert LN: Animals and AI. The role of animals in AI research and application – An overview and ethical evaluation. Technol Soc 2021; 67:101734.